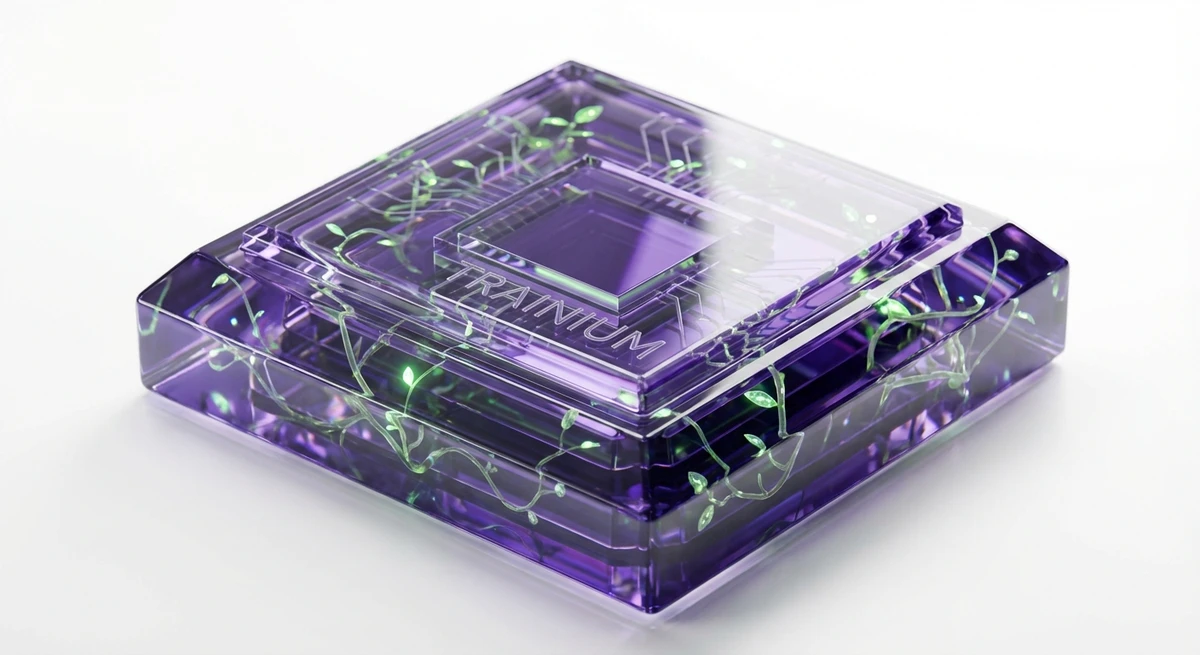

Amazon potichu staví zabijáka Nvidie. Jmenuje se Trainium a právě teď dospěl.

Válka o AI čipy není jen show jednoho muže. Zatímco se všichni dívají na Nvidii, AWS v tichosti buduje vlastní masivní arzenál v podobě akcelerátorů Trainium. A poslední generace, Trainium3, už není jen zajímavý experiment.

Jasně, všichni mluví o Nvidii. CUDA je zlatý standard, Blackwell vypadá jako monstrum a Jensen Huang je rocková hvězda v kožené bundě. Je to pochopitelné. Ale v pozadí, v datacentrech Amazonu, se děje něco, co by mohlo celou tuhle party docela slušně narušit. A já nemluvím o nějakém startupu s pár miliony v kapse. Mluvím o vertikálně integrované snaze jednoho z největších hráčů na planetě.

Co je sakra to Trainium?

Je důležité si hned na začátku ujasnit jednu věc. Trainium není GPU. Není to univerzální voják jako čipy od Nvidie. Je to ASIC, tedy Application-Specific Integrated Circuit. Přeloženo do lidštiny: kus křemíku navržený od základu pro jeden jediný úkol – co nejefektivnější trénování a inferenci velkých jazykových modelů. Nic víc, nic míň. Žádná grafika, žádné hry. Jen brutální, surový výkon pro maticové operace.

První generace byla spíš takový test. S druhou, Trainium2, to začalo být zajímavé. AWS tvrdilo, a data od zákazníků to potvrzovala, že nabízí o 30-40 % lepší poměr cena/výkon než tehdejší instance postavené na Nvidia A100/H100. To už je metrika, na kterou slyší každý CTO. Propojení NeuronLink umožnilo skládat instance se 16 čipy a stavět z nich ultra-klastry čítající desítky tisíc jednotek. Právě na tomhle běží třeba části modelů od Anthropic. To není jen marketing. To je reálný deployment.

Trainium3: Kde to začíná být osobní

Nová, třetí generace, o které se teď začíná mluvit, je ale úplně jiná liga. Tady už nejde jen o iteraci. Tady jde o přímý útok na největší slabiny současné generace AI hardwaru. Především paměť a interconnect. Nové modely jsou nenažrané a potřebují obrovskou paměťovou propustnost a schopnost efektivně komunikovat mezi tisíci čipy. A přesně na to se v AWS zaměřili.

Trainium3 přichází se 144 GiB HBM paměti na čip s propustností kolem 4.7 TB/s. To jsou čísla, která nechávají většinu konkurence daleko za sebou a přímo cílí na potřeby modelů, které přijdou v roce 2026. Ale ten skutečný klenot je jinde. Jmenuje se NeuronSwitch. Je to specializovaný switch fabric, který umožňuje skutečnou all-to-all konektivitu mezi čipy v masivním měřítku. Pro trénování Mixture-of-Experts (MoE) modelů, kde potřebujete neustále posílat data mezi různými "experty" (částmi modelu), je tohle naprosto klíčové. Eliminuje to úzká hrdla, která vznikají u tradičnějších topologií. AWS mluví o škálování až na milion čipů. Milion. To už není jen klastr, to je prakticky samostatná AI infrastruktura.

Software je bojiště

Hardware bez softwaru je jen drahé topení. A tady je ten největší otazník a zároveň největší příkop, který Nvidia okolo svého byznysu vykopala – CUDA. Celý ekosystém, knihovny, desetiletí optimalizací. Proti tomu staví Amazon svůj Neuron SDK. A upřímně, tady jsem nejvíc skeptický. Přimět vývojáře, aby přepsali a optimalizovali svůj kód pro novou platformu, je herkulovský úkol.

Amazon na to ale nejde úplně hloupě. Necílí na jednotlivé vývojáře. Cílí na ty největší ryby – Anthropic, OpenAI, Apple – a nabízí jim nejen hardware, ale i armádu svých inženýrů, aby jim pomohli s portací. Pro zákazníka, který pálí stovky milionů dolarů za cloudové služby, je úspora 30 % na trénování modelu absolutně zásadní a ospravedlní tu počáteční bolest s migrací. Je to sázka na vertikální integraci. Obrovská. Amazon neprodává čipy, prodává hotové, optimalizované a levnější výpočetní jednotky. A v tom je ten zásadní rozdíl oproti strategii Nvidie.