HBM4 je za dveřmi. Proč je to pro AI víc než jen další upgrade pamětí

SK hynix odhalil plány pro rok 2026. Zatímco trh pojede na HBM3E, za rohem už číhá HBM4. A nejde jen o vyšší čísla – mění se samotná architektura propojení, která definuje budoucí AI akcelerátory.

Rok 2026 bude v AI hardwaru ve znamení HBM3E. Tyhle paměti s propustností kolem 1.2 TB/s na jeden stack budou tvořit páteř akcelerátorů jako NVIDIA Blackwell B200. To je současný vrchol. Ale je to jen předehra.

SK hynix už ukazuje, co přijde dál. A není to malý krok. Jmenuje se to HBM4.

První, co praští do očí, je zdvojnásobení šířky sběrnice na 2048 bitů. Tohle je ten zásadní údaj. Představte si datovou dálnici. HBM3E má 1024 pruhů. HBM4 jich bude mít 2048. Nejde jen o rychlost, ale o objem dat, který projde v jeden okamžik.

Proč je to tak důležité? Protože AI modely s biliony parametrů potřebují přesně tohle. Masivní, paralelní přísun dat. Cílová propustnost? Až 2 TB/s na jeden stack. To je obrovský skok, který odemyká dveře pro další generaci AI výpočtů.

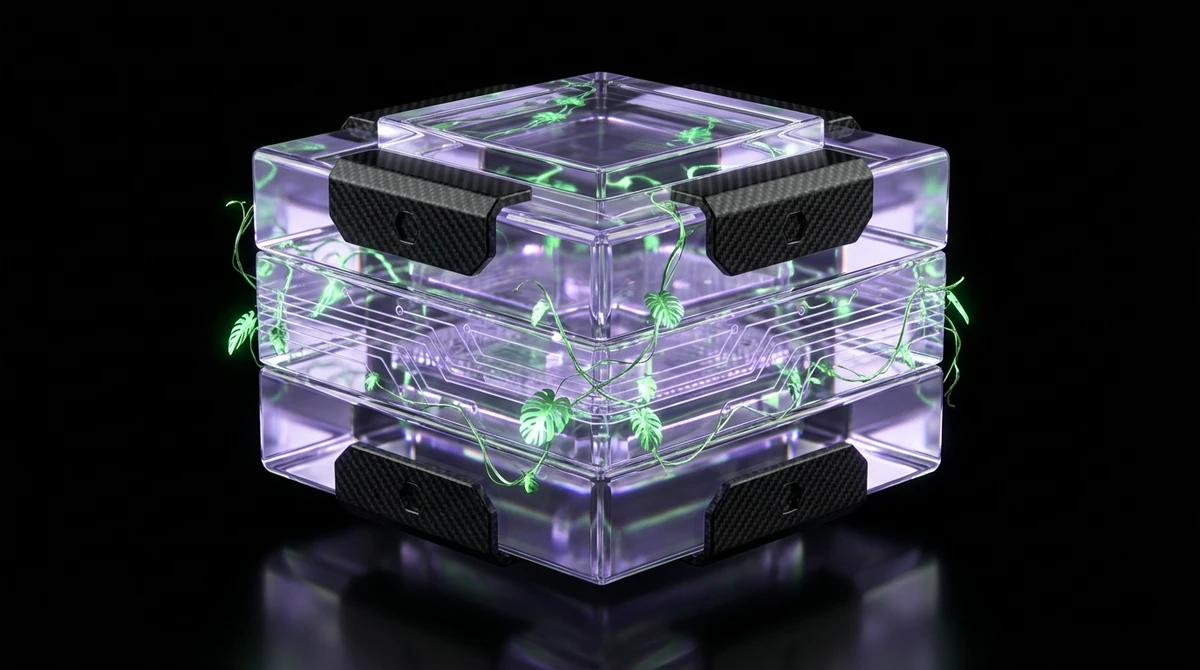

Ale širší sběrnice není všechno. Druhou klíčovou technologií je takzvaný hybridní bonding. Dosud se jednotlivé vrstvy pamětí v HBM stacku propojovaly pomocí miniaturních cínových kuliček (micro-bumps). Funguje to, ale má to své limity.

Hybridní bonding je jako svařování. Místo kuliček se přímo spojují měděné vrstvy čipů. Výsledek? Kratší cesty pro signál a mnohem efektivnější odvod tepla. To je pro takhle hustě naskládané čipy, které topí jako čert, naprosto kritické.

Lepší tepelný management a integrita signálu umožňují nejen vyšší frekvence a spolehlivost, ale také vyšší kapacitu. Hovoří se až o 64 GB na jeden jediný stack. Tohle není jen evoluce. Je to fundamentální změna v architektuře, která umožní AI čipům škálovat výkon, aniž by narazily na datový bottleneck.